NVIDIA GTC 2025 Keynote(基調講演)レポート~AIファクトリーとフィジカルAIで訪れるAI時代の転換点~

- NVIDIA

- GTC

- イベントレポート

- ../../../article/2025/04/gtc2025.html

こんにちは、ITPNAVIの加藤です。世界が注目する大企業NVIDIA®社が主催するカンファレンス「NVIDIA GTC 2026」。2024年と2025年に引き続き、3年連続で、アメリカで開催されたこちらのイベントに参加して参りました。本レポートでは、CEOのジェンスン・フアン氏によるKeynote(基調講演)の内容を分かりやすく、現地の盛り上がりとともにお伝えします。

【この記事を書いた人】ITPNAVI編集部 加藤優子

ITPNAVI編集部の加藤です!

連載「カトウタイムズ」でさまざまなIT関連の最新情報を、

SCSK社員である私の視点で皆様にお届けしています。

NVIDIA GTC 2026のGTCとは、GPU Technology Conferenceの略称で、NVIDIA社が主催する年に一度の技術カンファレンスを指します。AIアプリケーションおよびソフトウェア開発者向けの技術的なカンファレンスとなっており、NVIDIA社内外のビジネスリーダーや専門家、開発者による講演や、ハンズオントレーニング、スポンサー企業によるブース展示などがあります。

会場は、今年もカリフォルニア州サンノゼのコンベンションセンターで、2026年3月16日(月)~19日(木)(米国時間)の4日間に渡って開催されました。今年は世界中から450社以上のスポンサー企業、1,000のセッション、2,000人の講演者があり、GTC開催の1か月前から一部のカンファレンスパスが売り切れになるというほどの大盛況。サンノゼの街にはこれまでと同様にGTCの広告が至るところに掲げられていたほか、今年はなんと色々なロボットも歩き回っており、これぞフィジカルAI(※)!とテンションが上がりました。

自律的に動いて会話もできるロボット。かわいい

そもそもフィジカルAIとは?を詳しく知りたい方は、こちらの記事もご覧ください。

フィジカル AI(Physical AI)とは?生成AIやAIエージェントの次に来る、現実世界で「動くAI」の全貌を徹底解説!

GTCの一番の目玉は、NVIDIA社の創設者にしてCEOであるジェンスン・フアン氏のKeynote(基調講演)です。基調講演ではNVIDIA社の最新のソリューションや開発ロードマップが発表されるため、世界中が注目しています。

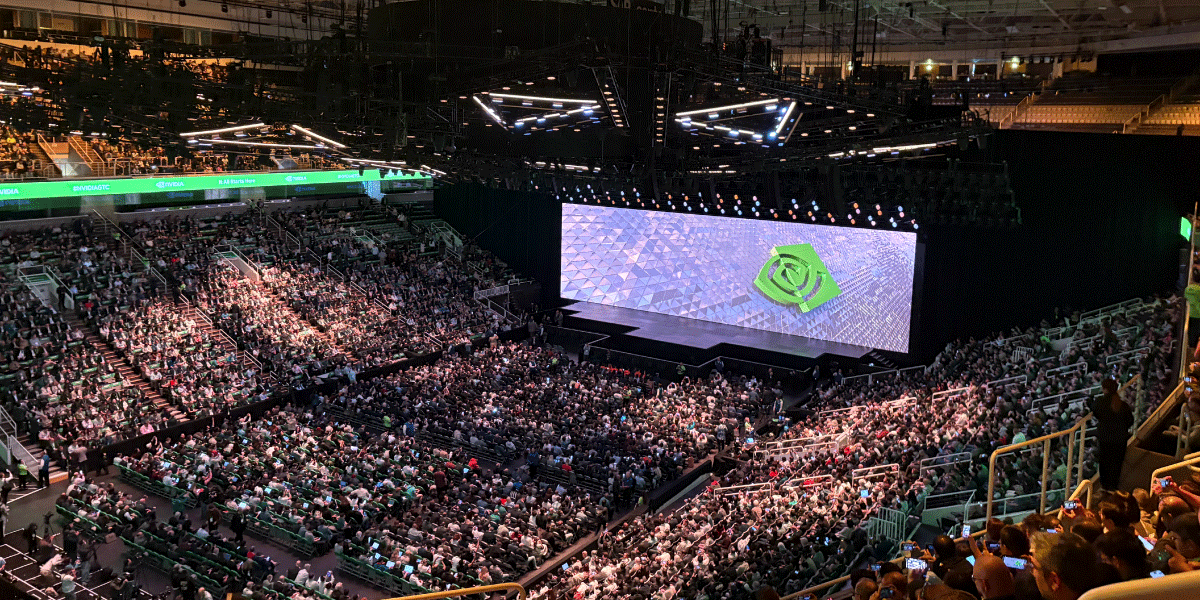

今年の基調講演は、会期初日の3月16日(月)11時(米国時間)からとなりました。会場はこれまた前回と同じく、メイン会場のサンノゼ コンベンションセンターから少し離れたSAPセンターで行われました。紛争問題の緊張もあり、バリケードや荷物検査などの警備が徹底されていました。

今年も超満員のSAPセンター

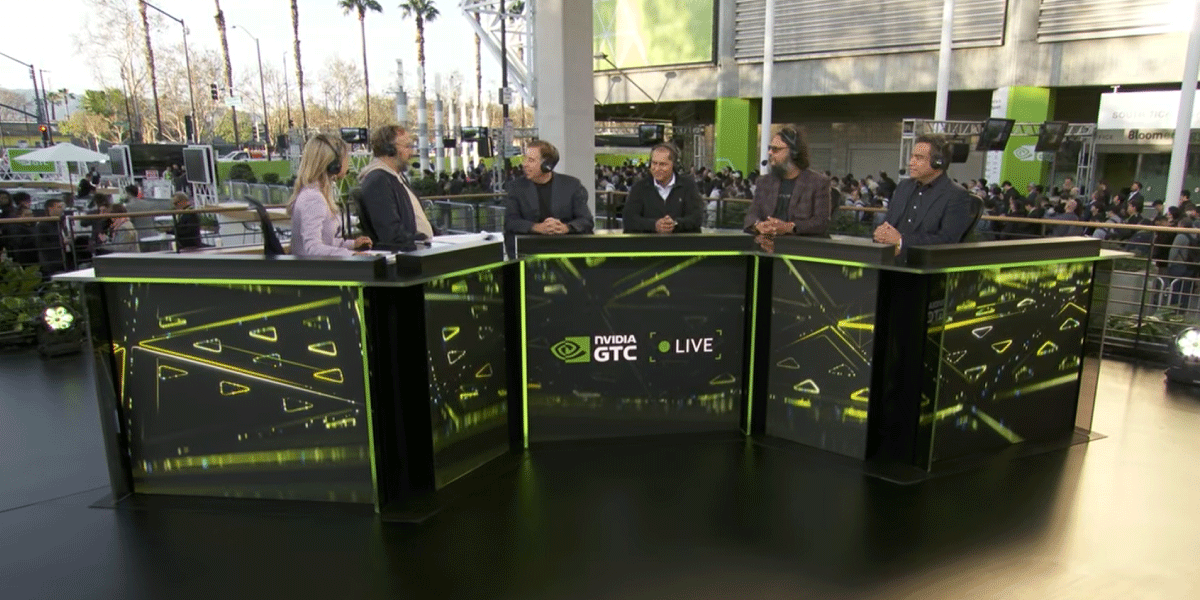

今年はKeynoteの前に、Keynote Pregame(プレゲーム)も用意されていました。サラ・グオ氏(AI特化VC「Conviction」の創設者)や、アルフレッド・リン氏(世界的VC「Sequoia Capital」のパートナー)らがホストとなり、さまざまなゲストへインタビュー。Keynoteで語られる「AIの5層のケーキ」や「AIファクトリー」といったキーワードを軸に話が展開され、今年の要点を先回りして整理してくれるウォームアップ的な位置づけとなりました。

(出典)NVIDIA

とは言っても、Keynote直前までSAPセンターとは別会場で行われていたため、残念ながら私は参加することができませんでした。ですがこちらのプレゲームはYouTubeで配信されていますので、興味がある方はぜひご覧ください。

(出典)NVIDIA

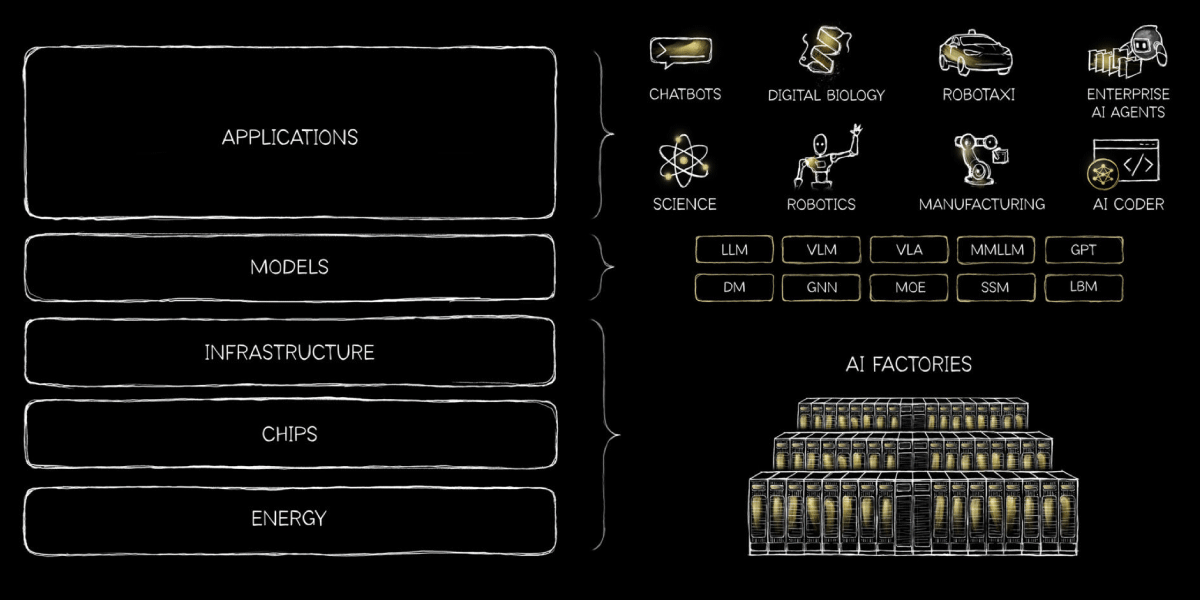

Keynoteはまず、AIを「5層のケーキ=レイヤー(インフラ→チップ→プラットフォーム→モデル→アプリ)」として捉えるという話から始まりました。ここでジェンスンが言いたいのは、「AIの価値はモデル単体では決まらない。最上段のアプリが立ち上がって初めて、あらゆる産業でAIが本格的に使われ、投資も需要も一気に加速する」という点です。

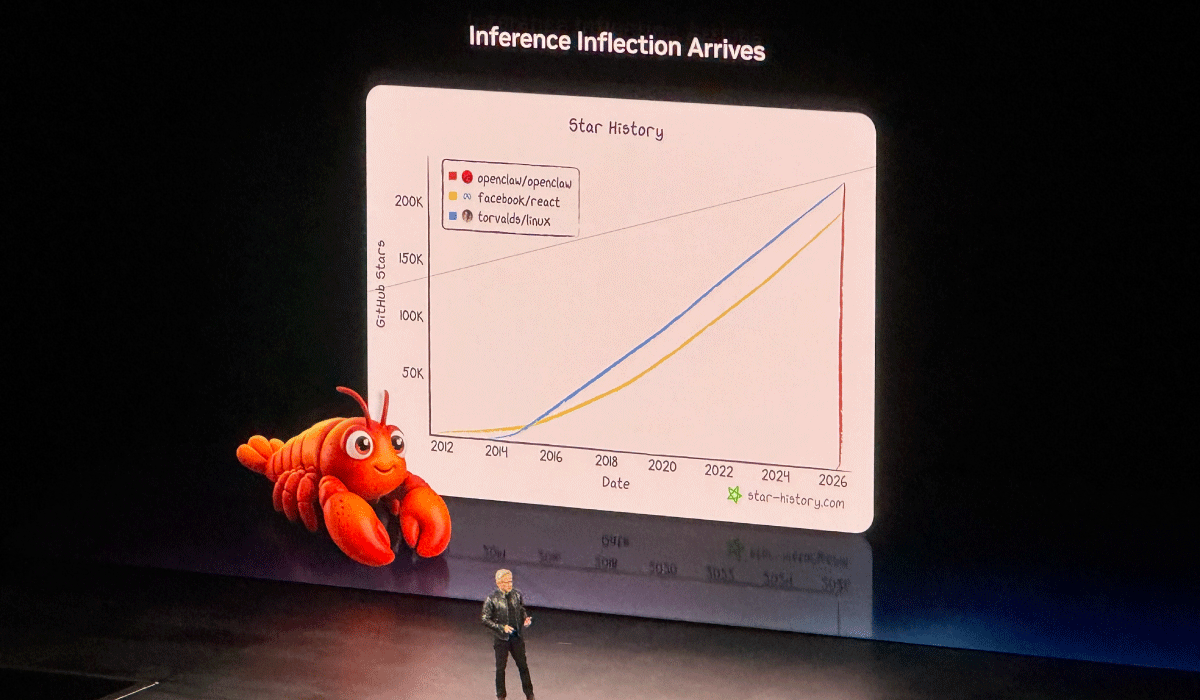

ではなぜアプリがそこまで重要なのか。それは、AIの進化が生成AI→推論AI(Reasoning)→AIエージェント/Agentic AIへ移り、アプリの中でAIが仕事をする存在になり始めたからです。ChatGPTのような生成AIはその手軽さによってAIを試せる環境を増やし、推論AIは考える力によって、AIの信頼性を高めました。そしてAIエージェントは単に回答するだけでなく、ツールやシステムを実際に使ってタスクを進め、仕事を完了させる段階へ踏み込みます。ここで決定的なのは、AIが仕事をするほど推論(=トークン生成)が増大することです。読むときも推論、考えるときも推論、ツールを使うときも推論。これを踏まえてジェンスンは「Inference Inflection(推論の時代、転換点)が来た」と言いました。AIは長いコンテキストを抱え、思考(考えながら出力する)を行い、ツール呼び出しを繰り返します。つまり、入力トークンも出力トークンも増え、推論の計算量が跳ね上がる。この増え方が、従来の常識をはるかに上回る時代が来ました。

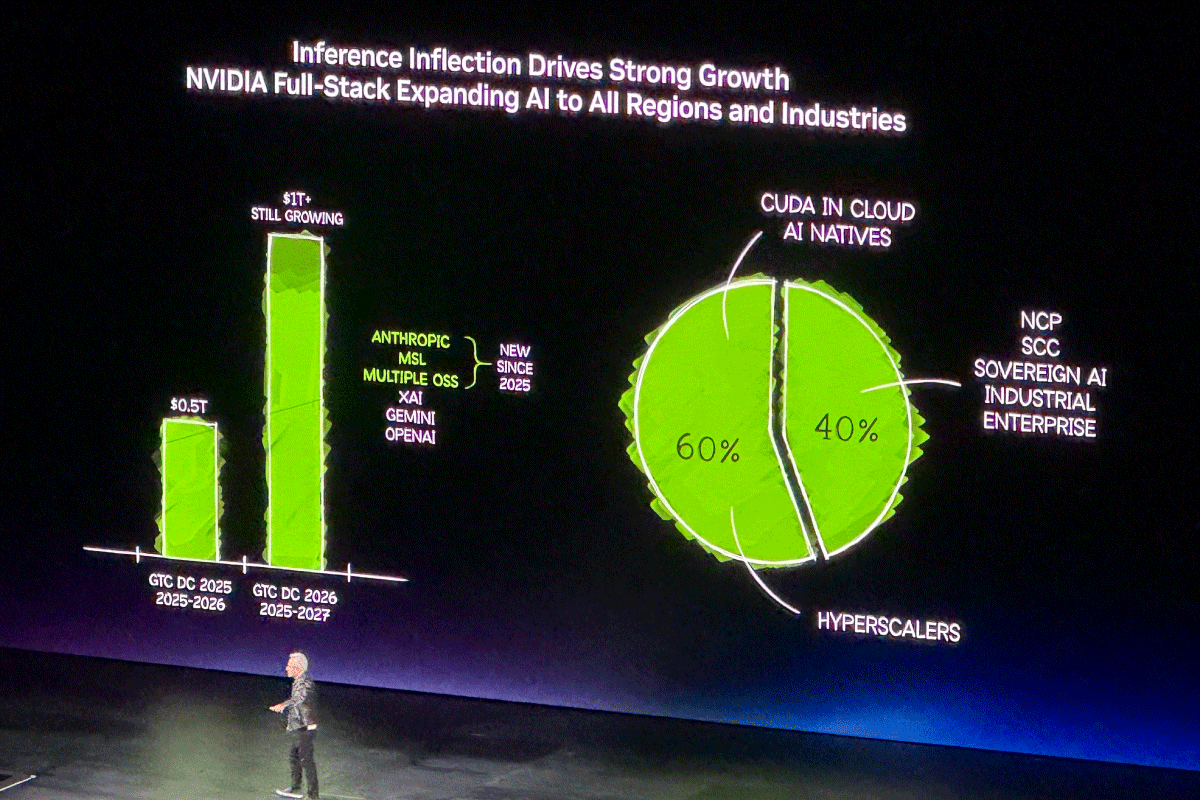

推論時代の到来は、AIファクトリー向けチップだけで2027年末までに最低1兆ドル規模という見込みにも現れている

結果として、企業にとって重要なことは「学習したモデル」を持つことより、「推論を回し続ける仕組み」を持つことへと変わります。だからデータセンターは「データを置く場所」から、AIファクトリーとして「トークンを作る工場」になっていくのです。

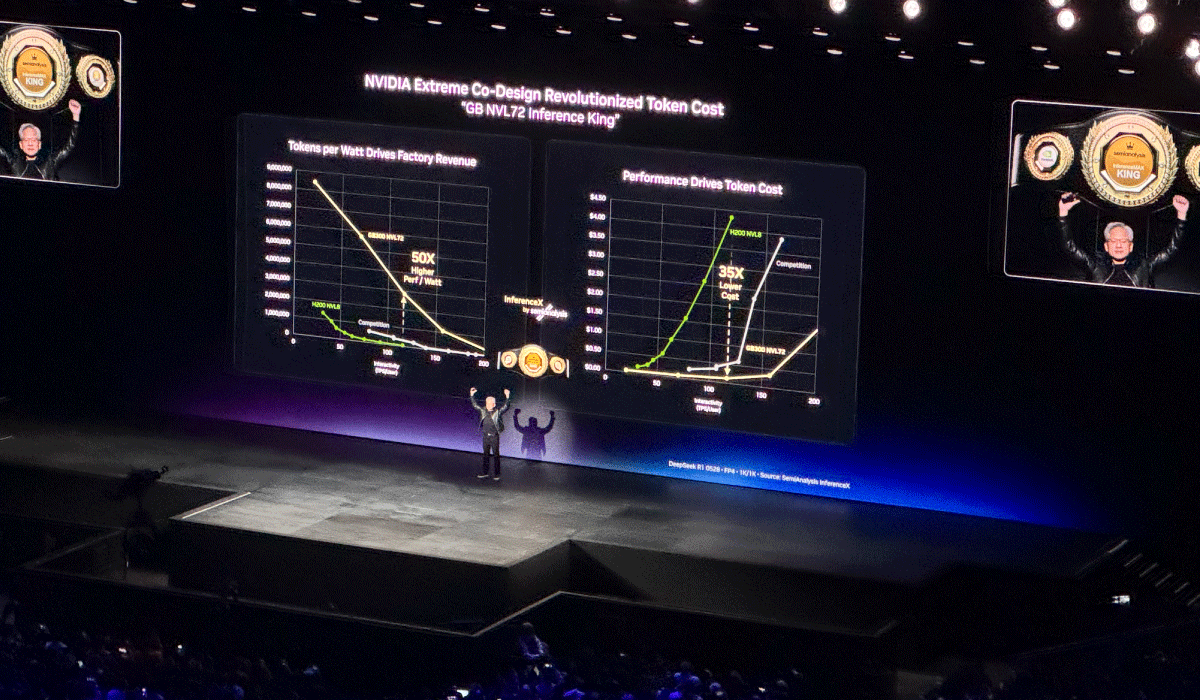

データセンターの性能は土地・電力・建屋などに縛られ、特に電力は簡単には増やせません。ならば、同じ電力でどれだけ多くのトークン(知能の出力)を生産できるかがAIファクトリーの収益性を決めます。トークン/ワットという考え方を前提に、トークンの生産力=スループットを最大化しつつ、応答速度の遅れ=レイテンシを最小化する(つまり応答速度を最大化する)、これら2つを同時に追求することが企業のビジネスに直結するようになります。ジェンスンはこの点を何度も強調し、「今後全てのCEOは、自社のAIインフラをこれらの指標で見るようになる」と述べました。

この前提に立つと、後述する新技術の発表がバラバラなものではなく、AIファクトリーの収益性を最大化するための構成要素であることが分かります。

それでは各新技術について詳しく見ていきましょう。

(出典)NVIDIA

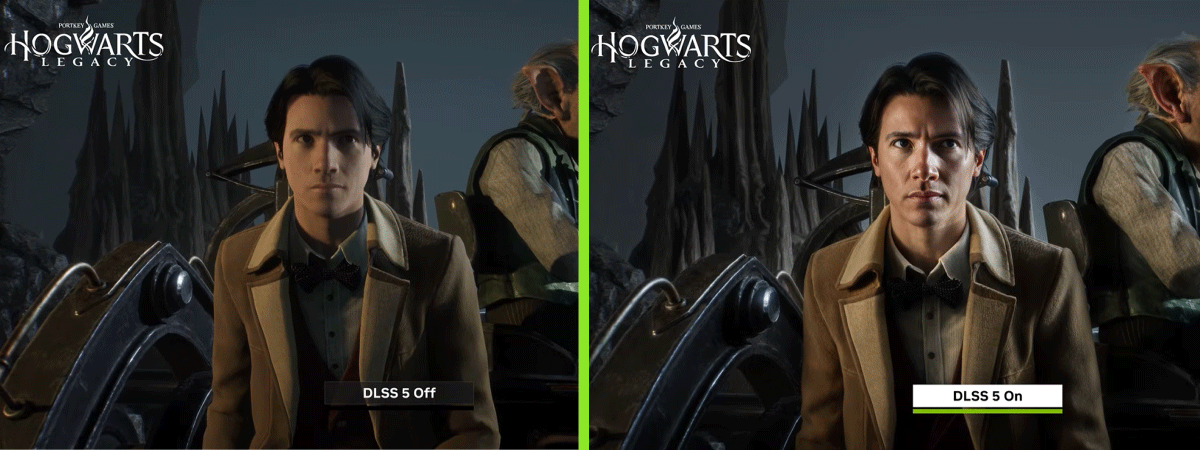

まず取り上げられたのが「DLSS 5(Neuro Rendering:ニューロレンダリング)」 です。一見すると、グラフィックスがすごい!というデモですが、本質はそこではありません。ここでジェンスンが伝えたかったのは、生成AIをいかに「信頼できる」形に近づけるか、その鍵がGround Truth(正解データ)との融合にあると示した点です。

ここで言うGround Truthとは、ゲームエンジンが持つ3D空間の設計図に基づく確かな情報、例えば各フレームの色情報や物体の動きを示すモーションベクトルなどを指します。そこに生成AIがフォトリアルなライティングとマテリアルを乗せます。重要なのは、AIがゼロから画像を作るのではなく、生成されたデータが元の3Dコンテンツ(Ground Truth)に紐づき、フレーム間で一貫性がある(制御できている)という点です。

Ground Truthで縛ると、生成は信頼(Trustworthy AI)に近づくという構図は、ゲームだけでなく企業のAI活用にもそのまま当てはまります。業務で求められるのはもっともらしい回答ではなく、根拠があり、説明でき、制御できること。DLSS 5はエンタメのデモを借りて、生成AIを信頼できる形にする鍵は「正解に相当するデータ」であると示したパートでした。

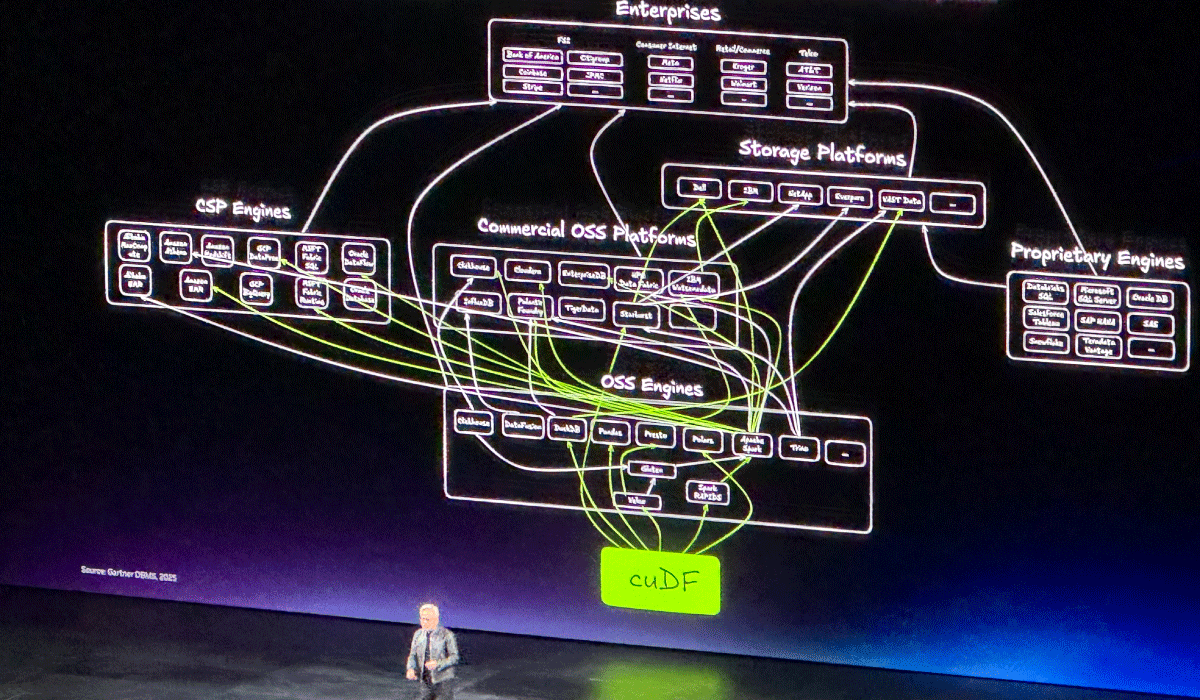

DLSS 5が示した「Ground Truth×生成AIによる精度向上」という型は、そのまま企業にも適用できます。企業が持つGround Truthなデータは大きく2種類あり、構造化データと非構造化データです。ちなみに世界のデータの約90%はPDFや動画などの非構造化データだと言われています。従来のAIでは非構造化データを扱うことが難しかったのですが、今やAIのマルチモーダル化によって、中身の意味をAIが理解し、検索・問い合わせ可能になりました。

そこでNVIDIAは、企業がもつさまざまなデータをAIが使いやすくするための基盤(ライブラリ)を新たに開発しました。それが構造化データ用の「cuDF」と、非構造化データ用の「cuVS」です。AIファクトリーにとってcuDF/cuVSは、信頼できるAIの原材料(データ)を滞らせずに流し込むベルトコンベアと言えます。ベルトが詰まれば工場の生産性(トークン/ワット)は頭打ちになってしまうため、とても重要な技術です。

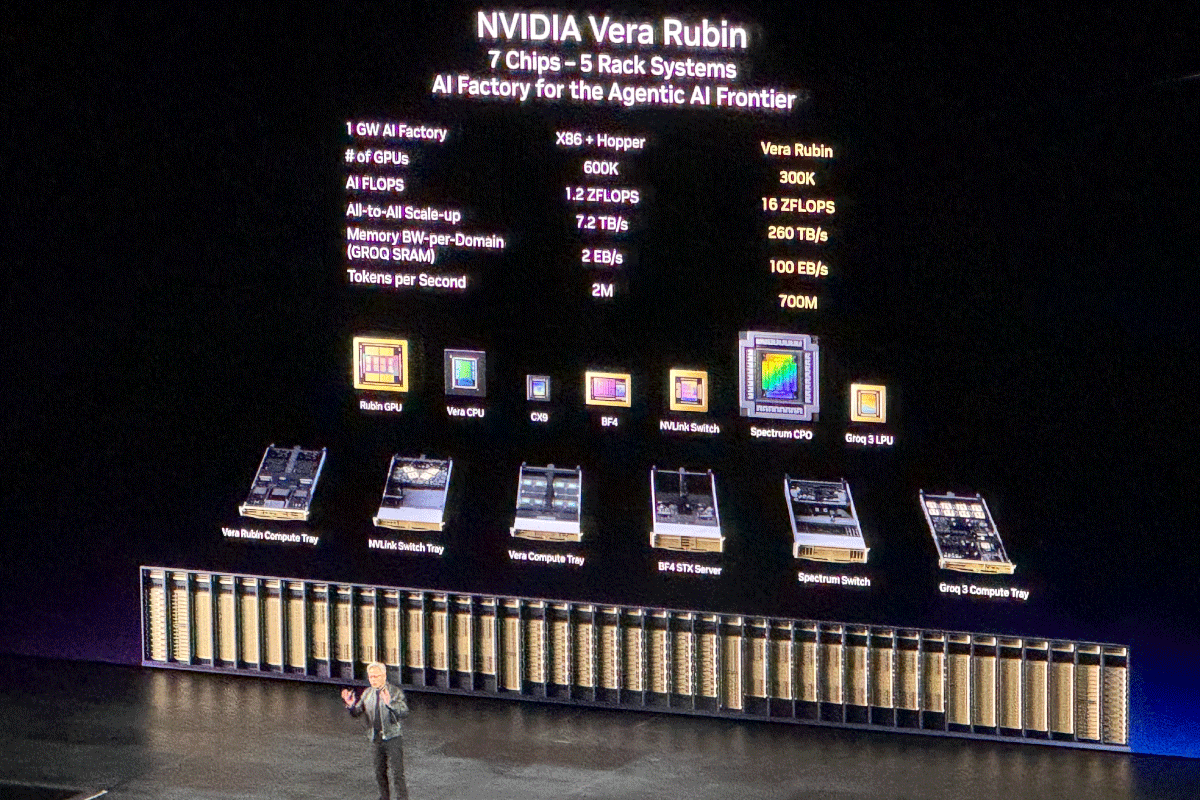

「NVIDIA Vera Rubin(以下、Vera Rubin)」と「NVIDIA Rubin Ultra(以下、Rubin Ultra)」は、AIによる大推論時代を見据えて設計された「世界最大級のAIファクトリー」のための次世代プラットフォームです。AI処理=GPUという従来の概念を超えて、CPU、ネットワーク、セキュリティなど全てが1つのシステムとして最適化されている点がポイントです。

まずVera Rubinは、AIエージェント向けに設計されたシステムで、Rubin GPUのほか、Vera CPUやNVIDIA Spectrum-X™ ネットワーク、AI-nativeストレージ、NVIDIA Groq 3 LPUなどから構成される基本ユニットです。これだけでも十分高性能ではありますが、単一ノードではこれからのAIファクトリーに求められるトークン生産力に届きません。

ここで必要になるのがRubin Ultraです。Vera Rubinを数百~数千規模で束ね、ほぼ一つのGPUのように、高密度・超高速に接続することによって、巨大な論理コンピュータ(One Giant Computer)として機能します。また、新しいサーバーラック「NVIDIA Kyber」によって、冷却システムは100%液冷に、そして45℃の温水冷却になりました。これにより、設置時間が2日から2時間へ短縮され、同時に冷却コストを下げることにも成功しました。

このように、NVIDIAはシステムのスケールアップ/スケールアウトを追求しつつ、「AIファクトリーを速く建て、速く回す」という運用面の改善を通して、AIファクトリーの収益性を高めています。

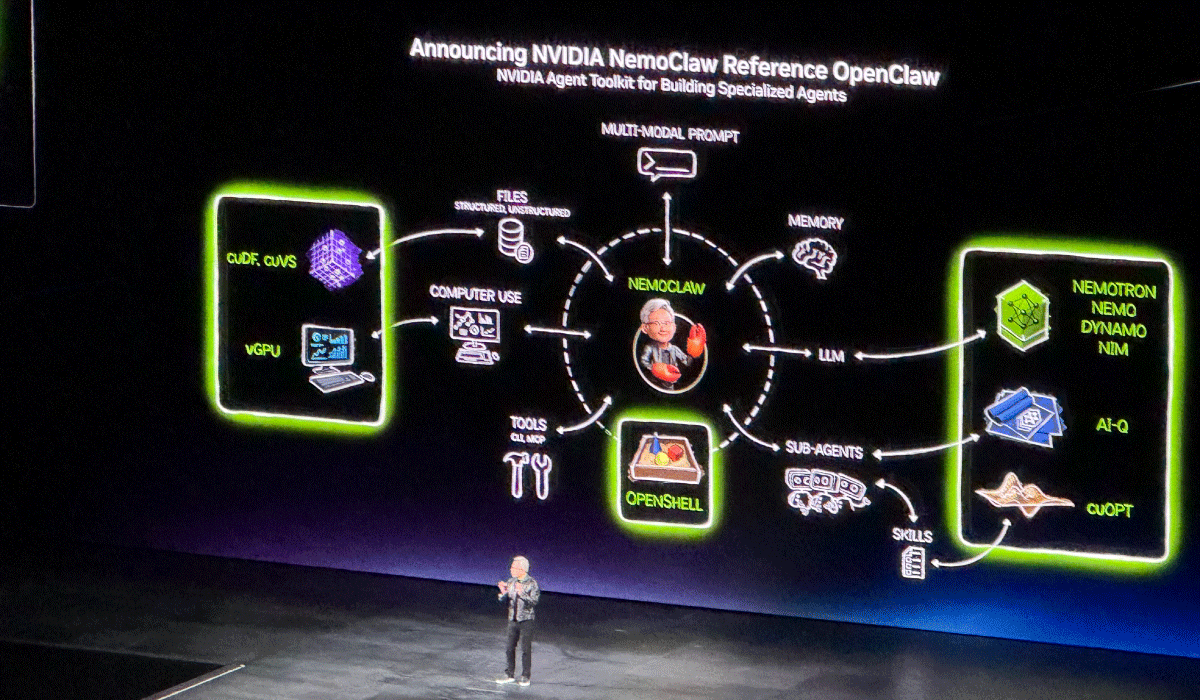

「OpenClaw」は、AIエージェント基盤として一般公開されているオープンソースです。OpenClawはLLMだけでなく、ツール、ファイル、スケジュール(ジョブ実行)、サブエージェント、そしてマルチモーダルI/Oなどを一元管理し、AIエージェントが仕事を回すための土台を提供します。ジェンスンはこれを「AIエージェントのOS」として強調しました。つまり、従来のOSがアプリや周辺機能を束ねてPCを動かしていたのと同じ発想で、「AIエージェントが動くための共通基盤」になっていくという宣言でした。

ただし、ここからが企業にとっての本題です。AIエージェントが企業ネットワーク内で動くと、機密情報へのアクセス、コード実行、外部通信が同時に起こり得ます。これは便利である一方、そのまま許容するのは非常に危険です。そこでNVIDIAが発表したのが「NVIDIA NemoClaw(以下NemoClaw)」というソフトウェアスタックです。NemoClawは、OpenClawにプライバシーおよびガードレールなどのセキュリティ制御を追加することで、企業が必要とする安全性をクリアし、ガバナンスを実現します。

この流れは、SaaSからAaaS(Agentic as a Service)へという市場の変化を示唆しています。従来のようにツール(ソフト)を提供するのではなく、AIエージェントを提供する時代へ――OpenClawとNemoClawは、その転換を前提にした次の土台を提供する仕組みと言えるでしょう。

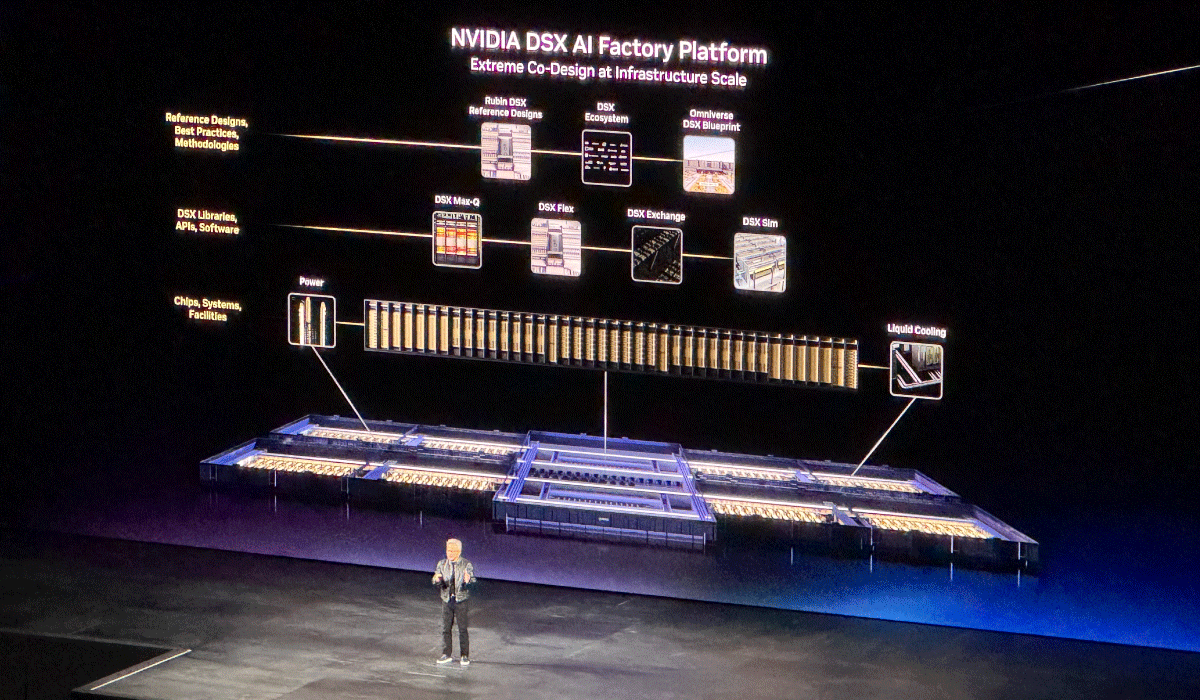

AIファクトリーは巨大で複雑なシステムです。現地で初めて複数のベンダー同士がすり合わせしながら導入していては時間がかかり過ぎてしまいます。AIファクトリーのKPIがトークン/ワットなら、未使用のワットは「失われた収益」です。さらに稼働後も、1ワットの無駄がそのまま収益損失になります。

つまりトークン/ワットを最大化するには、AIファクトリーの「建て方」と「回し方」が重要であり、そこで登場したのが「NVIDIA DSX(以下DSX)」です。DSXはNVIDIA Omniverse(以下Omniverse)のデジタルツイン上で、AIファクトリーの設計・運用をシミュレーションするプラットフォームです。GPUなどのチップから建屋のレイアウトまでを統合してモデル化することで、熱流体(冷却効率)やネットワーク、セキュリティなどのインフラ全体をデジタルツインで再現。事前検証はもちろん、稼働後もリアルタイムにシミュレーションすることによって、電力・冷却・配置の無駄を減らすことで、AIファクトリーの性能を向上させます。

Omniverseはこれまで、自動運転車の開発や製造業の工場設計、都市開発などでの活用が中心でしたが、AIファクトリーにも向けられたのが今年の大きな変化です。

Omniverseについてより詳しく知りたい方は、こちらの記事もご覧ください。

工場の「デジタルツイン」で働き方を変える。トヨタ自動車が目指す魅力的な職場づくり

Keynote終盤は、AIがデジタル世界の中だけで完結せず、現実世界で働く段階へ出ていくことを示すフィジカルAI(Physical AI)に大きく踏み込みました。象徴的だったのが、ディズニーのキャラクター「オラフ」をロボットとして登場させたデモです。オラフは「お腹の中にJetsonがある」と語り、ジェンスンが「Omniverseだ」と応じ、さらに「物理(Newton)が効いている」と締めました。ここで言うJetson(正式にはNVIDIA Jetson™)とは、ロボットやAIカメラに組み込むための強力かつ小型のAIコンピュータであり、画像認識や自律走行などの高度なAI処理をエッジでリアルタイムに行うためのものです。またNewton(正式にはNVIDIA Newton)は、Disney Researchらと共同開発した、ロボットの学習や検証に使うシミュレーションのリアルさを支える物理エンジンです。

ジェンスンとオラフのこの短いやり取りは、デジタルツイン(Omniverse)で学び、実機(Jetson)で動き、物理(Newton)で現実に適応するという、フィジカルAIの要点(いわゆるSim-to-Real)を一瞬で伝える演出でした。

(出典)NVIDIA

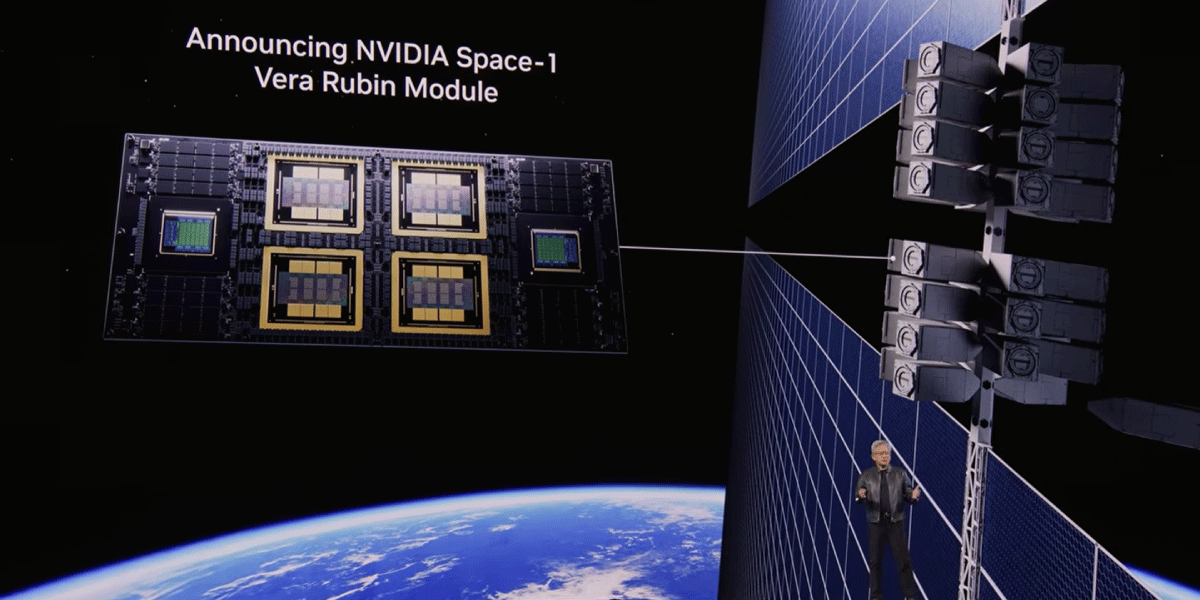

一方で、もう一つ印象的だったのがSpace Computingです。NVIDIAは宇宙空間での運用を想定したAI計算基盤として、「Space-1 Vera Rubin Module(以下、Space-1)」を発表しました。これまで、衛星が撮影したデータは一度地上に送られてから、気象予測や安全保障などの用途に処理されてきました。そこで、「データが生成される場所(エッジ)でAI処理を行う」ことによって、不要なデータ転送やレイテンシを削減し、AI処理を高速化するというエッジAIの発想を、地上から宇宙へ拡張したのがSpace-1です。宇宙空間でAIファクトリー級の推論を行い、地上↔宇宙/宇宙↔宇宙でAIを動かすという方向性が語られました。

ただし宇宙は簡単ではありません。ジェンスンも「宇宙には対流がなく、放射で冷却しなければならない」と述べており、冷却が大きな技術課題であることを示しています。それでも宇宙を語った意味は明確で、AIファクトリーの概念が「現実で動く(フィジカルAI)」だけでなく、それを「どこに置くか(地上→宇宙)」という展開の議論にまで広がったことを象徴しています。

なお、基調講演のフルバージョンはYouTubeで日本語字幕付き公開されています。現地の盛り上がりをぜひ体感してみてください。:ご視聴はこちら

今年のKeynoteをひと言でまとめるなら、AIは「モデルを賢くする競争」から、推論(Inference)を回し続けて価値を生む「運用の競争」へ移った、ということです。ジェンスンが強調したInference Inflection(推論の時代)は、AIのエージェント化によって「読む・考える・実行する」すべてで推論が連続発生し、トークンが増え続ける構造が本格化した、という宣言です。

だからこそ、電力をトークンへ変換するAIファクトリーが求められ、KPIはトークン/ワットに置き換わります。DLSS 5は、正解のデータ(Ground Truth)と生成AIを組み合わせた信頼できるAI(Trustworthy AI)の型を示しました。cuDF/cuVSは、企業データ(構造化/非構造化)を詰まらせずに流し込むデータ供給ラインとして、推論の常時稼働を支えます。さらに、OpenClawの安全性を企業が使えるレベルに高めたNemoClaw。最後に、フィジカルAIによって、AIのデジタルから現実世界への拡張を、Space‑1によって、地上から宇宙への拡張を印象づけました。推論に支えられるAIエージェントが仕事を回し、現実や宇宙へ広がっていく――そんな世界を見せてくれたKeynoteでした。

※出典の無い画像は筆者撮影